以案視法丨謹防侵權 用AI生成數字文化創意內容,需規避這些風險

隨著人工智能技術的迅猛發展,AI生成內容(AIGC)已成為數字文化創意產業的新引擎,從文本、圖像到音樂、視頻,其應用場景不斷拓展。在享受高效與創新紅利的AIGC在知識產權、內容合規、數據安全等方面也潛藏著不容忽視的法律風險。本文結合案例與法規,剖析在數字文化創意內容應用服務中使用AIGC時應注意規避的關鍵風險。

一、知識產權侵權風險:訓練數據與輸出成果的“原罪”

AI模型的訓練依賴于海量數據,這些數據可能包含受版權保護的文字、圖像、代碼等。若未經授權使用,可能構成對原作復制權、改編權的侵害。

案例警示:2023年,某國際圖庫起訴一AI公司,指控其利用數百萬張版權圖片訓練模型,生成風格相似的新圖像,涉嫌大規模版權侵權。此案凸顯了訓練數據來源的合法性危機。

規避建議:

1. 數據來源合規:優先使用經授權、開源或自行創作的數據集,建立數據溯源與合規審核機制。

2. 輸出內容審查:對AI生成的內容進行知識產權篩查,避免與現有作品構成實質性相似。

3. 合同明確權責:在使用第三方AI工具時,需在服務協議中明確數據來源、版權歸屬與侵權責任劃分。

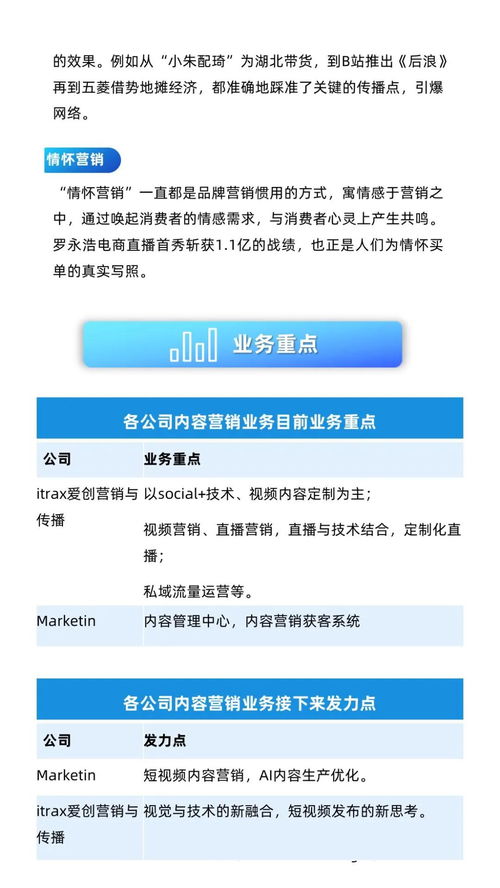

二、內容合規風險:算法偏差與有害信息的“失控”

AI可能基于有偏見或違規的數據,生成包含虛假信息、歧視性言論、暴力色情等不良內容,引發法律與道德問題。

案例警示:某社交平臺因AI生成并傳播虛假新聞,被監管部門約談,暴露出內容審核機制的漏洞。

規避建議:

1. 植入合規算法:在模型訓練中注入倫理規則與法律法規要求,從源頭降低有害內容生成概率。

2. 人工審核強化:建立“AI生成+人工復核”的雙重過濾機制,特別對涉及公共利益、價值觀導向的內容嚴格把關。

3. 實時監測與應急:部署內容監測系統,對已發布內容進行動態跟蹤,并制定違規內容緊急下架預案。

三、數據安全與隱私風險:用戶輸入與模型記憶的“黑洞”

用戶在與AI交互時輸入的信息,可能被用于模型迭代訓練,導致敏感數據泄露;AI可能“記憶”并還原訓練數據中的個人隱私。

案例警示:有研究發現,某些AI模型可根據提示詞還原出訓練數據中包含的個人電子郵件片段,引發隱私泄露擔憂。

規避建議:

1. 數據脫敏處理:對訓練數據及用戶交互信息進行匿名化、去標識化處理。

2. 訪問權限控制:嚴格限制對訓練數據及用戶數據的內部訪問權限,防止未授權使用。

3. 用戶知情同意:明確告知用戶數據使用目的、范圍及存儲方式,并獲得有效授權。

四、版權歸屬與商業糾紛風險:誰是“作者”?

AI生成內容的版權歸屬尚無全球統一標準。是歸屬于開發者、使用者,還是AI本身?權屬模糊易引發商業合作中的利益沖突。

案例警示:某公司使用AI生成的設計圖進行商業宣傳,被同行指控侵權,雙方對設計圖的“創作主體”各執一詞。

規避建議:

1. 提前約定權屬:在項目合作前,以書面合同明確AI生成內容的著作權、專利權等知識產權歸屬。

2. 保留創作痕跡:保存AI生成過程中的提示詞、參數設置、修改記錄等,作為主張權利的證據。

3. 關注立法動態:密切關注國內外關于AIGC版權歸屬的司法判例與立法進展,及時調整合規策略。

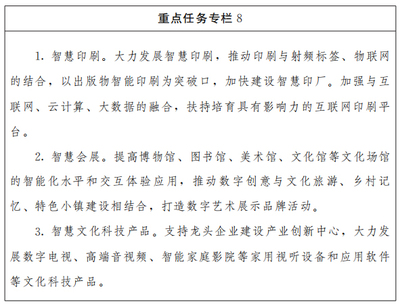

五、行業應用建議:構建全鏈條風險管理體系

對于數字文化創意內容應用服務提供者,應樹立“合規先行”理念:

- 上游:選擇合規的AI工具與數據供應商,進行供應商盡職調查。

- 中游:將法律審核嵌入內容生產流程,開展員工AI合規培訓。

- 下游:對發布平臺的內容履行監管義務,建立用戶投訴與侵權響應機制。

###

AI為數字文化創意產業帶來了前所未有的生產力變革,但唯有在法律與倫理的軌道上運行,才能行穩致遠。從業者需以案為鑒,主動規避風險,在創新與合規之間找到平衡點,共同推動產業健康、可持續發展。

如若轉載,請注明出處:http://www.sihaizi.com/product/35.html

更新時間:2026-05-11 00:27:07